Готовность делегировать цифровому ассистенту

В гиде по UX-метрикам я писал, что показателей много, но есть ограниченный набор сущностей, которые интересны для замера с точки зрения дизайна и продукта. Похоже, с развитием ИИ-помощников на сцену выходит новая концепция — готовность человека делегировать выполнение и/или принятие решений цифровому ассистенту.

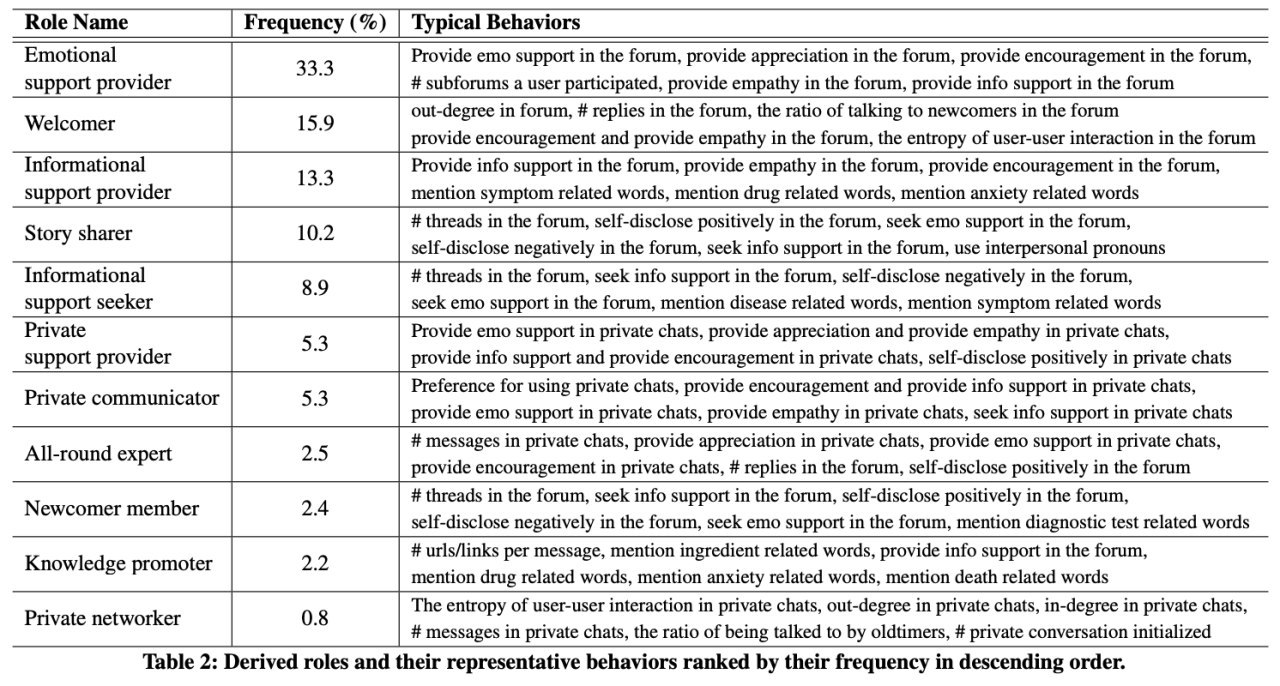

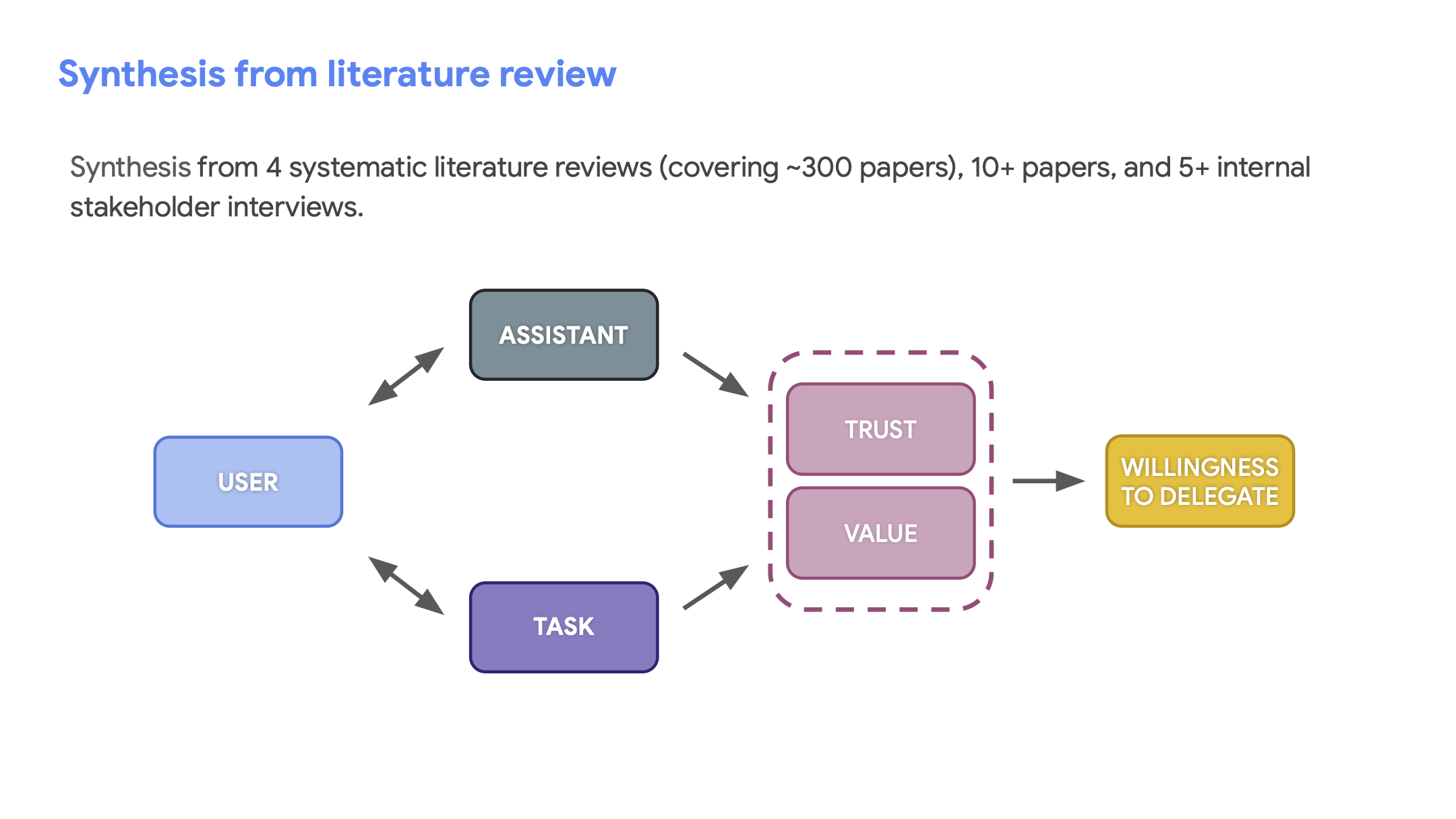

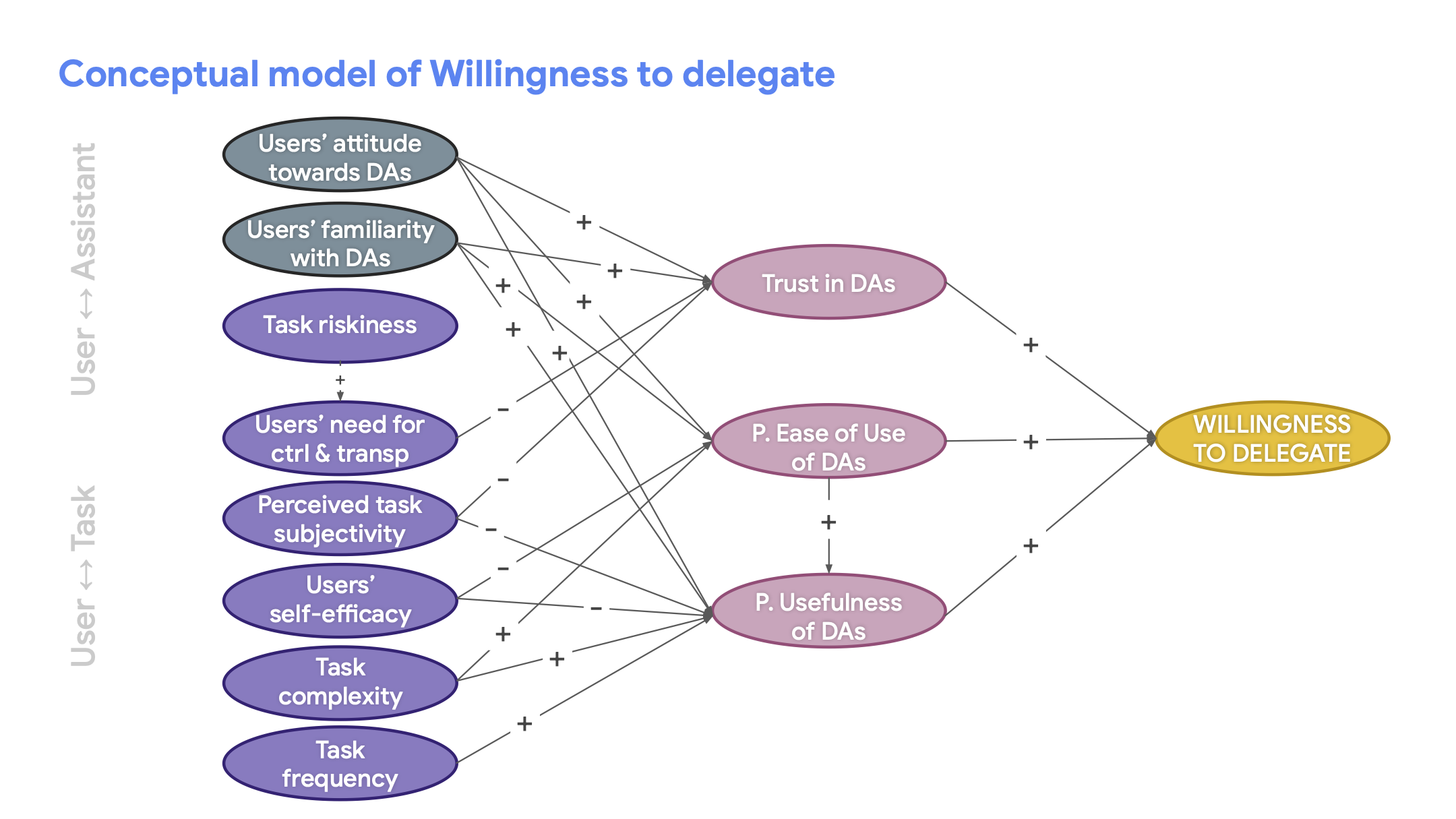

В работе Expectation vs Reality in Users’ Willingness to Delegate to Digital Assistants создается модель «готовности делегировать»: определены основные «переменные» и причинно-следственные связи.

Исследование опубликовано в начале 2023г, поэтому часть тезисов выглядят банальными, а рекомендации устаревшими, но все еще злободневно даже три года спустя.

Ключевые тезисы и рекомендации

Завышенные ожидания пользователей от ассистентов

- Чем проще работа с ассистентом, тем выше желание делегировать ему задачу (или как минимум попробовать)

- При этом, чем больше человек пробовал работать с агентами, тем меньше желание делегировать (видимо, столкнулся с негативным опытом и понял ограничения)

Выводы отсюда очевидные: работать над качеством, менеджить ожидания, более сдержанно давать обещания

Процесс работы ассистентов не прозрачен, а контроля практически нет

Чем важнее задача, тем меньше желание делегировать. Так как нет доверия к системе, то и делегировать «субъективно рисковые» задачи не хочется. Даже если пользователь думает, что агент мог бы быть полезен.

Чтобы повысить шанс допуска агентов к более сложным задачам со стороны юзера, нужно:

- Определить сценарии, где людям нужен больший контроль.

- Бить критичные задачи на подзадачи, объяснять что будет сделано, дать контроль порядком шагов и их наполнением

Полезность ассистентов возрастает, когда человеку сложно выполнить задачу, но при этом увеличивается и субъективная сложность работы

- Используйте ситуации, в которых пользователям сложно выполнить задачу без посторонней помощи, например, когда у них заняты руки или они не видят экран, чтобы продемонстрировать преимущества помощника.

- Сделайте взаимодействие в таких ситуациях ещё проще

Частотность сценариев работы ассистента не связана с субъективной полезностью, но повышает доверие к системе

Например, пользователи не доверяют ИИ в вопросах, связанных со страховыми случаями, хотя в этом случае ассистенты кажутся полезными. Пользователи доверяют роботам в вопросах информации о погоде, но это не самый полезный сценарий.

Сортировать беклог только по частотности сценария выглядит не самым разумным подходом.